小龙虾OpenClaw放大招,2026最大的AI风暴来袭!

谁也没料到,一场“养龙虾”的狂欢,竟然成了开源AI Agent项目OpenClaw起飞的燃料。

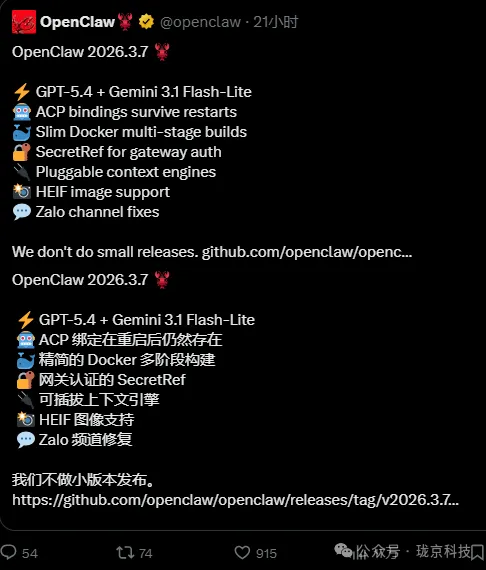

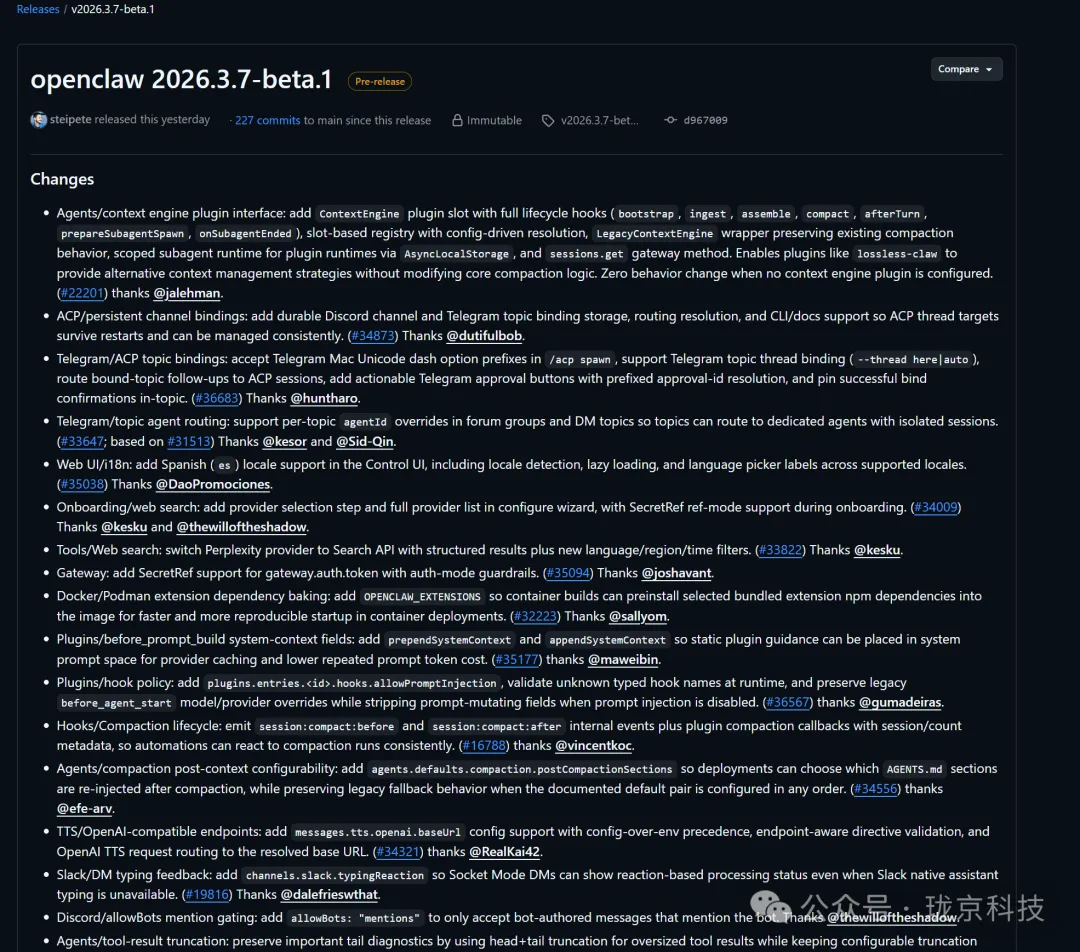

就在刚刚,OpenClaw创始人Peter Steinberger在X上轻描淡写地扔下了一枚重磅炸弹:v2026.3.7-beta.1正式发布。

没有华丽的发布会,没有慷慨激昂的演讲,只有一份密密麻麻的更新日志:89项代码提交,200+个Bug修复。

这条推文瞬间点燃了整个社区。

如果说之前的OpenClaw还只是极客圈子里的玩具,那么这次更新,无疑是在向世界宣告:属于自托管AI Agent的时代,真的来了。

废话不多说,让我们一起来拆解一下,这个被称为“开源里程碑”的版本,到底硬核在哪。

看点一:双引擎加持

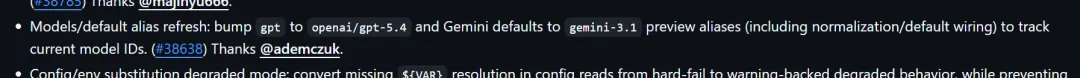

这次更新最直观的变化,是适配了OpenAI最新的GPT-5.4和Google的Gemini 3.1 Flash。

但OpenClaw做的,绝不仅仅是简单接入。它内置了一个聪明的“模型降级与重试机制”。当你正在调用的模型因为访问量过大而限流或过载时,系统不会傻傻地抛出一个报错让你干瞪眼,而是自动、无缝地切换到备选模型。

这意味着什么?

想象一下,你面前放着一个“模型路由器”。前端是你熟悉的聊天界面(比如Slack、Telegram),而后端则连接着市面上几乎你能想到的所有大模型:Claude、GPT、Gemini、DeepSeek……哪个好用用哪个,哪个便宜切哪个。

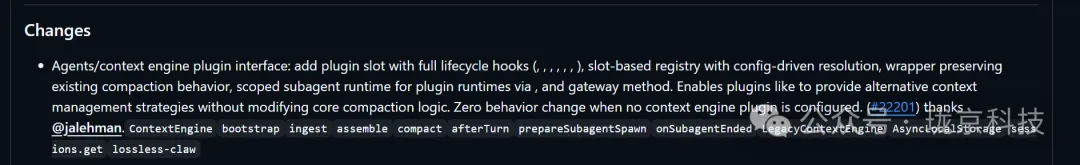

看点二:神器ContextEngine上线

这才是这次更新最硬核、最让开发者激动的地方——全新的ContextEngine插件接口。

做过AI应用的朋友都懂,上下文管理是智能体开发中最让人头疼的。

对话一长,Token就爆;信息一压缩,关键细节就丢。

更痛苦的是,一旦把处理逻辑写死在核心代码里,以后每次调整都像在心脏上动刀,风险极高。

OpenClaw这次直接把这个问题给解决了,它开放了一组完整的生命周期钩子(bootstrap, ingest, assemble, compact...),让开发者可以在不修改一行核心代码的情况下,完全自定义上下文的处理逻辑。

你想用RAG(检索增强生成)?可以。想实现激进压缩?随意。

想让不同子任务拥有隔离的记忆空间?接口都给你准备好了。

有人评论:“等这个接口等了快半年。” 这条评论的点赞数瞬间过百。

这波操作的意义在于,它把OpenClaw从一个好用的“工具”,变成了一个充满想象力的“平台”。

可以预见,一个围绕上下文管理的插件生态,即将爆发。

看点三:200+项Bug修复

200多项Bug修复,这个数字本身就足以说明问题。

这不仅仅是修修补补,它覆盖了Telegram草稿流、Discord断连、Slack消息路由、飞书Webhook、iOS/macOS端边界情况……几乎你能想到的每一个角落。

它还修复了工具调用时的参数解析、上下文压缩时的信息丢失、流式输出的兼容性、内存检索的去重、SQLite的锁冲突,甚至包括依赖库的安全升级和沙盒逃逸的防范。

这种对细节和稳定性的极致追求,恰恰是开源项目能够长线运营下去的照妖镜。它证明了这个项目不是“写完就扔”的实验品,而是被一个庞大社区持续打磨、真正在生产环境中使用的“重器”。

看点四:让AI Agent真正“落地”你的团队

多渠道接入一直是OpenClaw的核心卖点,而这次,它在两个最活跃的团队协作平台上做了深度优化:

Discord:修复了断连后无法恢复的死机问题,这意味着你的AI Bot再也不会在关键时刻“掉线”了。

Telegram:新增了主题级别(Topic)的智能体路由隔离。你可以想象一下,在一个大型Telegram群组里,你可以为“技术支持”主题配置一个专业的客服Agent,为“闲聊吹水”主题配置一个幽默风趣的聊天Agent,两者互不干扰,各司其职。

同时,两个平台都新增了持久化频道绑定功能。重启服务后,绑定关系依然存在,再也不用每次重启都重新配置一遍了。

这些看似“细枝末节”的更新,恰恰是让AI Agent从一个“玩具”变成一个“生产力工具”的关键一步。它让AI真正融入了团队的日常工作流。

养龙虾的“避坑”建议

虽然“养龙虾”代表了未来消费端智能体的发展趋势。借用大佬周鸿祎今天在采访的话:它将“智能体”这一抽象概念“物化”了,让每个人只要有台电脑,就能“养”一个属于自己的智能体,这对智能体的普及和推广具有积极意义。

甚至有投资人认为,这场“数字牛马”变革的烈度可能是移动互联网的5到10倍!

但由于“养龙虾”这个潮流还处于早期,还是有不少避坑事项。

首先,在本地跑Agent,安全是第一位的。由于需要访问邮箱、日历、系统命令等核心权限,其安全漏洞被顶级投资机构视为“致命”。

虽然新版本做了不少安全方面的优化,但第一批“养虾者”们,更多还是准备一台独立的设备,比如闲置的 Mac Mini,配独立的邮箱,物理隔离个人隐私。

其次,就是让大家吐槽的“安装部署”。虽然现在市面上已经有了不少收费或免费的教程。但选择错误的部署环境是新手最常见的坑。

值得一提的是,在关键配置方面,如果设置不当,会导致龙虾失忆,或者性能不佳。

思考:开源的边界在哪里?

看完这密密麻麻的更新日志,我不禁在想一个问题:在AI这个巨头林立的赛道里,开源的边界到底在哪里?

大厂的优势是显而易见的:超强的算力、顶级的团队、海量的用户数据、精致丝滑的产品体验。

这些都是一个小团队或一个开源项目短期内难以企及的。

但OpenClaw的故事,给了我们一个不同的答案:信任与控制感。

当你把AI部署在自己的服务器上,当你可以随时查看每一行源码、随时修改逻辑、随时切换模型——这种完全掌控的感觉,是大厂那精美的黑盒产品永远给不了的。

这次3.7 Beta更新,或许没有改变什么赛道格局,但它实实在在地让这个工具变得更稳、更开放、更可信。

下一个AI工具,你会把数据交给谁?是云端的某个大厂,还是你自家服务器上那个24小时亮着绿灯的小盒子?

我想,OpenClaw的爆发,已经给出了答案。